Il Linguaggio di Programmazione Rust

di Steve Klabnik e Carol Nichols con contribuzioni dalla comunità di Rust; tradotto in Italiano dal Rust User Group di Verona grazie al lavoro degli studenti dell'ITIS G. Marconi

Questa versione del libro assume che tu stia utilizzando Rust 1.67.1 (rilasciato il 9 febbraio 2023) o successivo. Consulta la sezione "Installazione" del capitolo 1 per imparare a installare o aggiornare Rust.

Altre traduzioni curate dalla comunità sono disponibili nell'elenco dedicato.

Prefazione

Non è sempre stato così chiaro, ma il linguaggio di programmazione Rust è fondamentalmente circa l'empowerment: non importa che tipo di codice stai scrivendo ora, Rust ti dà il potere di andare più lontano, di programmare con fiducia in una varietà più ampia di domini che prima.

Prendi, ad esempio, il lavoro a "livello di sistema" che si occupa di dettagli di basso livello di gestione della memoria, rappresentazione dei dati e Concurrency. Tradizionalmente, questo ambito di programmazione è visto come arcano, accessibile solo a pochi eletti che hanno dedicato gli anni necessari per imparare a evitare le sue trappole infami. E anche coloro che lo praticano lo fanno con cautela, affinché il loro codice non sia aperto a exploit, crash, o corruzione.

Rust elimina queste barriere eliminando le vecchie trappole e fornendo un set di strumenti amichevole e lucidato per aiutarti lungo il percorso. I programmatori che hanno bisogno di "scendere" a un controllo di livello inferiore possono farlo con Rust, senza assumere il rischio abituale di crash o buchi di sicurezza, e senza dover imparare i punti sottili di un toolchain capriccioso. Ancora meglio, il linguaggio è progettato per guidarti naturalmente verso il codice affidabile che è efficiente in termini di velocità e uso della memoria.

I programmatori che stanno già lavorando con codice a basso livello possono usare Rust per aumentare le loro ambizioni. Ad esempio, l'introduzione del parallelismo in Rust è una operazione a basso rischio: il compilatore catturerà i classici errori per te. E puoi affrontare ottimizzazioni più aggressive nel tuo codice con la fiducia che non introdurrà accidentalmente crash o vulnerabilità.

Ma Rust non si limita alla programmazione di sistemi a basso livello. È abbastanza espressivo e ergonomico per rendere piacevole scrivere app CLI, server web e molti altri tipi di codice - troverai semplici esempi di entrambi più avanti nel libro. Lavorare con Rust ti permette di sviluppare competenze che si trasferiscono da un dominio all'altro; puoi imparare Rust scrivendo un'app web, poi applicare quelle stesse competenze per targettare il tuo Raspberry Pi.

Questo libro abbraccia pienamente il potenziale di Rust per potenziare i suoi utenti. È un testo amichevole e accessibile, pensato per aiutarti a fare un salto di livello non solo nella tua conoscenza di Rust, ma anche nel tuo reach e nella tua confidenza come programmatore in generale. Quindi immergiti, preparati a imparare - e benvenuto nella comunità Rust!

— Nicholas Matsakis e Aaron Turon

Introduzione

Nota: Questa edizione del libro è la stessa de Il Libro del Linguaggio di Programmazione Rust disponibile in formato cartaceo ed ebook da No Starch Press.

Benvenuti in Il Linguaggio di Programmazione Rust, un libro introduttivo su Rust. Il linguaggio di programmazione Rust ti aiuta a scrivere software più veloce e affidabile. L'ergonomia ad alto livello e il controllo a basso livello sono spesso in conflitto nel design dei linguaggi di programmazione; Rust sfida questo conflitto. Attraverso il bilanciamento della capacità tecnica potente e un'ottima esperienza per lo sviluppatore, Rust ti offre l'opzione di controllare i dettagli a basso livello (come l'uso della memoria) senza tutto il disturbo tradizionalmente associato a tale controllo.

Per chi è Rust

Rust è ideale per molte persone per una varietà di motivi. Diamo un'occhiata ad alcuni dei gruppi più importanti.

Team di Sviluppatori

Rust si sta dimostrando uno strumento produttivo per la collaborazione tra grandi team di sviluppatori con livelli di conoscenza dei sistemi di programmazione variabili. Il codice a basso livello è incline a vari bug sottili, che nella maggior parte degli altri linguaggi possono essere catturati solo attraverso test estensivi e un'accurata revisione del codice da parte di sviluppatori esperti. In Rust, il compilatore svolge il ruolo di guardiano rifiutandosi di compilare codice con questi bug elusivi, inclusi i bug di concorrenza. Lavorando insieme al compilatore, il team può concentrare il loro tempo sulla logica del programma piuttosto che a rincorrere bug.

Rust porta anche strumenti di sviluppo contemporanei nel mondo della programmazione di sistemi:

- Cargo, il gestore delle dipendenze integrato e strumento di build, rende l'aggiunta, la compilazione e la gestione delle dipendenze indolore e coerente nell'ecosistema Rust.

- Lo strumento di formattazione Rustfmt assicura uno stile di codifica coerente tra gli sviluppatori.

- Il rust-analyzer alimenta l'integrazione dell'Integrated Development Environment (IDE) per il completamento del codice e i messaggi di errore in linea.

Usando questi e altri strumenti dell'ecosistema Rust, gli sviluppatori possono essere produttivi mentre scrivono codice a livello di sistema.

Studenti

Rust è per studenti e per coloro che sono interessati ad apprendere i concetti dei sistemi. Usando Rust, molte persone hanno imparato argomenti come lo sviluppo di sistemi operativi. La comunità è molto accogliente e felice di rispondere alle domande degli studenti. Attraverso sforzi come questo libro, i team di Rust vogliono rendere i concetti dei sistemi più accessibili a più persone, specialmente a coloro che sono nuovi alla programmazione.

Aziende

Centinaia di aziende, grandi e piccole, usano Rust in produzione per una varietà di compiti, tra cui strumenti a riga di comando, servizi web, strumenti DevOps, dispositivi embedded, analisi e transcodifica audio e video, criptovalute, bioinformatica, motori di ricerca, applicazioni Internet of Things, apprendimento automatico, e anche parti importanti del browser web Firefox.

Sviluppatori Open Source

Rust è per le persone che vogliono costruire il linguaggio di programmazione Rust, la comunità, gli strumenti per sviluppatori e le librerie. Ci piacerebbe che tu contribuissi al linguaggio Rust.

Persone che Valutano Velocità e Stabilità

Rust è per le persone che desiderano velocità e stabilità in un linguaggio. Per velocità, intendiamo sia quanto rapidamente il codice Rust può essere eseguito sia la velocità con cui Rust ti permette di scrivere programmi. I controlli del compilatore di Rust garantiscono stabilità attraverso aggiunte di funzionalità e refactoring. Questo è in contrasto con il codice legacy fragile nei linguaggi senza questi controlli, che gli sviluppatori spesso hanno paura di modificare. Puntando su astrazioni a costo zero, funzionalità di alto livello che si compilano in codice di basso livello veloce come il codice scritto manualmente, Rust si sforza di far sì che il codice sicuro sia anche codice veloce.

Il linguaggio Rust spera di supportare anche molti altri utenti; quelli menzionati qui sono solo alcuni dei principali stakeholder. In generale, la più grande ambizione di Rust è eliminare i compromessi che i programmatori hanno accettato per decenni, fornendo sicurezza e produttività, velocità e ergonomia. Prova Rust e vedi se le sue scelte funzionano per te.

Per chi è questo libro

Questo libro presume che tu abbia scritto codice in un altro linguaggio di programmazione ma non fa alcuna supposizione su quale. Abbiamo cercato di rendere il materiale ampiamente accessibile a coloro che provengono da una vasta gamma di background di programmazione. Non dedichiamo molto tempo a parlare di cosa sia la programmazione o di come pensarla. Se sei completamente nuovo alla programmazione, sarebbe meglio che leggessi un libro che fornisce specificamente un'introduzione alla programmazione.

Come utilizzare questo libro

In generale, questo libro presume che tu lo stia leggendo in sequenza dalla prima all'ultima pagina. I capitoli successivi si basano sui concetti dei capitoli precedenti, e i capitoli precedenti potrebbero non approfondire i dettagli su un argomento particolare ma lo riprenderanno in un capitolo successivo.

Troverai due tipi di capitoli in questo libro: capitoli concettuali e capitoli di progetto. Nei capitoli concettuali, imparerai un aspetto di Rust. Nei capitoli di progetto, costruiremo piccoli programmi insieme, applicando ciò che hai imparato finora. I capitoli 2, 12 e 20 sono capitoli di progetto; il resto sono capitoli concettuali.

Il Capitolo 1 spiega come installare Rust, come scrivere un programma “Hello, world!” e come usare Cargo, il gestore di pacchetti e strumento di build di Rust. Il Capitolo 2 è un'introduzione pratica alla scrittura di un programma in Rust, facendoti costruire un gioco di indovinelli. Qui copriamo i concetti a un alto livello e i capitoli successivi forniranno dettagli aggiuntivi. Se vuoi sporcarti le mani subito, il Capitolo 2 è il posto giusto per farlo. Il Capitolo 3 copre le funzionalità di Rust simili a quelle di altri linguaggi di programmazione, e nel Capitolo 4 imparerai il sistema di ownership di Rust. Se sei un apprendista particolarmente meticoloso che preferisce imparare ogni dettaglio prima di passare al successivo, potresti voler saltare il Capitolo 2 e andare direttamente al Capitolo 3, tornando al Capitolo 2 quando vuoi lavorare a un progetto applicando i dettagli che hai imparato.

Il Capitolo 5 discute delle structs e dei metodi, e il Capitolo 6 copre le enums, le espressioni match e il costrutto di controllo del flusso if let. Userai structs e enums per creare tipi personalizzati in Rust.

Nel Capitolo 7, imparerai il sistema di module di Rust e le regole di privacy per organizzare il tuo codice e la sua interfaccia pubblica di programmazione delle applicazioni (API). Il Capitolo 8 discute alcune strutture dati di raccolta comuni che la libreria standard fornisce, come vettori, strings e hash maps. Il Capitolo 9 esplora la filosofia e le tecniche di gestione degli errori di Rust.

Il Capitolo 10 approfondisce i generics, i traits e i lifetimes, che ti danno il potere di definire codice che si applica a più tipi. Il Capitolo 11 parla di testing, che anche con le garanzie di sicurezza di Rust, è necessario per garantire che la logica del tuo programma sia corretta. Nel Capitolo 12, costruiremo la nostra implementazione di un sottoinsieme delle funzionalità dello strumento a riga di comando grep che cerca testo all'interno dei file. Per questo, useremo molti dei concetti discussi nei capitoli precedenti.

Il Capitolo 13 esplora le closures e gli iterators: funzionalità di Rust che provengono dai linguaggi di programmazione funzionali. Nel Capitolo 14, esamineremo Cargo in maggior dettaglio e parleremo delle migliori pratiche per condividere le tue librerie con altri. Il Capitolo 15 discute i smart pointers che la libreria standard fornisce e i traits che abilitano la loro funzionalità.

Nel Capitolo 16, esamineremo diversi modelli di programmazione concorrente e parleremo di come Rust ti aiuti a programmare senza paura con più threads. Il Capitolo 17 guarda a come gli idiomi di Rust si confrontano ai principi di programmazione orientata agli oggetti con cui potresti avere familiarità.

Il Capitolo 18 è un riferimento su pattern e pattern matching, che sono modi potenti di esprimere idee attraverso i programmi Rust. Il Capitolo 19 contiene una varietà di argomenti avanzati di interesse, inclusi unsafe Rust, macro, e altro sui lifetimes, traits, tipi, funzioni e closures.

Nel Capitolo 20, completeremo un progetto in cui implementeremo un server web multithread a basso livello!

Infine, alcuni appendici contengono informazioni utili sul linguaggio in un formato più simile a un riferimento. L'Appendice A copre le parole chiave di Rust, l'Appendice B copre gli operatori e i simboli di Rust, l'Appendice C copre i traits derivabili forniti dalla libreria standard, l'Appendice D copre alcuni strumenti di sviluppo utili, e l'Appendice E spiega le edizioni di Rust. Nell'Appendice F, puoi trovare traduzioni del libro, e nell'Appendice G copriremo come viene realizzato Rust e cos'è il Rust nightly.

Non c'è un modo sbagliato di leggere questo libro: se vuoi saltare avanti, fallo! Potresti dover tornare indietro a capitoli precedenti se incontri delle confusioni. Ma fai ciò che funziona per te.

Una parte importante del processo di apprendimento di Rust è imparare a leggere i messaggi di errore che il compilatore mostra: questi ti guideranno verso il codice funzionante. Come tale, forniremo molti esempi che non si compilano insieme al messaggio di errore che il compilatore ti mostrerà in ogni situazione. Sappi che se inserisci ed esegui un esempio casuale, potrebbe non compilarsi! Assicurati di leggere il testo circostante per vedere se l'esempio che stai cercando di eseguire è destinato a dar luogo a un errore. Ferris ti aiuterà anche a distinguere il codice che non è destinato a funzionare:

| Ferris | Significato |

|---|---|

| Questo codice non si compila! | |

| Questo codice genera un panic! | |

| Questo codice non produce il comportamento desiderato. |

Nella maggior parte delle situazioni, ti guideremo verso la versione corretta di qualsiasi codice che non si compila.

Codice Sorgente

I file sorgente da cui è generato questo libro possono essere trovati su GitHub.

Iniziare

Iniziamo il tuo viaggio con Rust! C'è molto da imparare, ma ogni viaggio inizia da qualche parte. In questo capitolo, discuteremo di:

- Installare Rust su Linux, macOS e Windows

- Scrivere un programma che stampa

Hello, world! - Utilizzare

cargo, il gestore dei pacchetti e il sistema di build di Rust

Installazione

Il primo passo è installare Rust. Scaricheremo Rust tramite rustup, uno

strumento da riga di comando per gestire le versioni di Rust e gli strumenti associati. Avrai bisogno

di una connessione internet per il download.

Nota: Se preferisci non usare

rustupper qualche motivo, per favore consulta la pagina Altri Metodi di Installazione di Rust per altre opzioni.

I seguenti passaggi installano l'ultima versione stabile del compilatore Rust. Le garanzie di stabilità di Rust assicurano che tutti gli esempi nel libro che compilano continueranno a compilare con le versioni più recenti di Rust. L'output potrebbe differire leggermente tra le versioni perché Rust spesso migliora i messaggi di errore e avvisi. In altre parole, qualsiasi versione stabile più recente di Rust che installi utilizzando questi passaggi dovrebbe funzionare come previsto con il contenuto di questo libro.

Notazione della Riga di Comando

In questo capitolo e in tutto il libro, mostreremo alcuni comandi utilizzati nel terminale. Le righe che dovresti inserire in un terminale iniziano tutte con

$. Non è necessario digitare il carattere$; è il prompt della riga di comando mostrato per indicare l'inizio di ciascun comando. Le righe che non iniziano con$di solito mostrano l'output del comando precedente. Inoltre, gli esempi specifici di PowerShell utilizzeranno>anziché$.

Installazione di rustup su Linux o macOS

Se utilizzi Linux o macOS, apri un terminale ed inserisci il seguente comando:

$ curl --proto '=https' --tlsv1.2 https://sh.rustup.rs -sSf | sh

Il comando scarica uno script e avvia l'installazione dello strumento rustup,

che installa l'ultima versione stabile di Rust. Potrebbe essere richiesto di

inserire la tua password. Se l'installazione riesce, apparirà la seguente riga:

Rust is installed now. Great!

Avrai bisogno anche di un linker, che è un programma che Rust utilizza per unire i suoi output compilati in un unico file. È probabile che tu ne abbia già uno. Se ottieni errori di linker, dovresti installare un compilatore C, che tipicamente includerà un linker. Un compilatore C è utile anche poiché alcuni comuni pacchetti di Rust dipendono dal codice C e avranno bisogno di un compilatore C.

Su macOS, puoi ottenere un compilatore C eseguendo:

$ xcode-select --install

Gli utenti Linux dovrebbero generalmente installare GCC o Clang, secondo la documentazione

della loro distribuzione. Ad esempio, se utilizzi Ubuntu, puoi installare il pacchetto build-essential.

Installazione di rustup su Windows

Su Windows, vai su https://www.rust-lang.org/tools/install e segui le istruzioni per installare Rust. Ad un certo punto nell'installazione, ti verrà chiesto di installare Visual Studio. Questo fornisce un linker e le librerie native necessarie per compilare i programmi. Se hai bisogno di ulteriore aiuto con questo passaggio, vedi https://rust-lang.github.io/rustup/installation/windows-msvc.html

Il resto di questo libro utilizza comandi che funzionano sia in cmd.exe che in PowerShell. Se ci sono differenze specifiche, spiegheremo quale utilizzare.

Risoluzione dei Problemi

Per verificare se hai installato correttamente Rust, apri una shell ed inserisci questa riga:

$ rustc --version

Dovresti vedere il numero di versione, l'hash del commit, e la data del commit per l'ultima versione stabile che è stata rilasciata, nel seguente formato:

rustc x.y.z (abcabcabc yyyy-mm-dd)

Se vedi queste informazioni, hai installato Rust con successo! Se non vedi queste informazioni,

controlla che Rust sia nella tua variabile di sistema %PATH% come segue.

In Windows CMD, usa:

> echo %PATH%

In PowerShell, usa:

> echo $env:Path

In Linux e macOS, usa:

$ echo $PATH

Se tutto è corretto e Rust continua a non funzionare, ci sono diversi posti dove puoi ottenere aiuto. Scopri come metterti in contatto con altri Rustaceans (un soprannome scherzoso che ci chiamiamo) sulla pagina della community.

Aggiornamento e Disinstallazione

Una volta installato Rust tramite rustup, aggiornare ad una versione rilasciata di recente è

facile. Dal tuo shell, esegui il seguente script di aggiornamento:

$ rustup update

Per disinstallare Rust e rustup, esegui il seguente script di disinstallazione dal tuo

shell:

$ rustup self uninstall

Documentazione Locale

L'installazione di Rust include anche una copia locale della documentazione in modo

che tu possa leggerla offline. Esegui rustup doc per aprire la documentazione

locale nel tuo browser.

Ogni volta che un tipo o una funzione viene fornito dalla libreria standard e non sei sicuro di cosa faccia o di come usarlo, usa la documentazione dell'interfaccia di programmazione dell'applicazione (API) per scoprirlo!

Hello, World!

Ora che hai installato Rust, è il momento di scrivere il tuo primo programma Rust. È tradizione, quando si impara un nuovo linguaggio, scrivere un piccolo programma che stampa il testo Hello, world! sullo schermo, quindi faremo lo stesso qui!

Nota: Questo libro presuppone una familiarità di base con la riga di comando. Rust non impone richieste specifiche su quali strumenti o editor utilizzare o dove il tuo codice debba risiedere, quindi se preferisci utilizzare un ambiente di sviluppo integrato (IDE) anziché la riga di comando, sentiti libero di usare il tuo IDE preferito. Molti IDE ora hanno un certo grado di supporto per Rust; consulta la documentazione dell’IDE per i dettagli. Il team di Rust si è concentrato sul fornire un ottimo supporto IDE tramite

rust-analyzer. Consulta Appendix D per ulteriori dettagli.

Creazione di una Directory di Progetto

Inizierai creando una directory per memorizzare il tuo codice Rust. Non importa a Rust dove risiede il tuo codice, ma per gli esercizi e i progetti in questo libro, suggeriamo di creare una directory projects nella tua directory home e di mantenere lì tutti i tuoi progetti.

Apri un terminale ed inserisci i seguenti comandi per creare una directory projects e una directory per il progetto "Hello, world!" all'interno della directory projects.

Per Linux, macOS e PowerShell su Windows, inserisci questo:

$ mkdir ~/projects

$ cd ~/projects

$ mkdir hello_world

$ cd hello_world

Per Windows CMD, inserisci questo:

> mkdir "%USERPROFILE%\projects"

> cd /d "%USERPROFILE%\projects"

> mkdir hello_world

> cd hello_world

Scrivere ed Eseguire un Programma Rust

Successivamente, crea un nuovo file sorgente e chiamalo main.rs. I file Rust terminano sempre con l'estensione .rs. Se stai utilizzando più di una parola nel nome del tuo file, la convenzione è di usare un underscore per separarle. Ad esempio, usa hello_world.rs anziché helloworld.rs.

Ora apri il file main.rs che hai appena creato e inserisci il codice nel Listato 1-1.

fn main() { println!("Hello, world!"); }

Salva il file e torna alla finestra del tuo terminale nella directory ~/projects/hello_world. Su Linux o macOS, inserisci i seguenti comandi per compilare ed eseguire il file:

$ rustc main.rs

$ ./main

Hello, world!

Su Windows, inserisci il comando .\main.exe invece di ./main:

> rustc main.rs

> .\main.exe

Hello, world!

Indipendentemente dal tuo sistema operativo, la stringa Hello, world! dovrebbe essere stampata nel terminale. Se non vedi questo output, consulta la parte “Troubleshooting” della sezione Installazione per modi su come ottenere aiuto.

Se Hello, world! è stato stampato, congratulazioni! Hai ufficialmente scritto un programma Rust. Questo ti rende un programmista Rust—benvenuto!

Anatomia di un Programma Rust

Esaminiamo in dettaglio questo programma “Hello, world!”. Ecco il primo elemento del puzzle:

fn main() { }

Queste righe definiscono una funzione chiamata main. La funzione main è speciale: è sempre il primo codice che viene eseguito in ogni programma Rust eseguibile. Qui, la prima riga dichiara una funzione di nome main che non ha parametri e non restituisce nulla. Se ci fossero parametri, essi andrebbero messi tra le parentesi ().

Il Blocco della funzione è racchiuso tra {}. Rust richiede parentesi graffe attorno a tutti i blocchi delle funzioni. È buona norma posizionare la parentesi graffa di apertura sulla stessa linea della dichiarazione della funzione, aggiungendo uno spazio in mezzo.

Nota: Se vuoi aderire a uno stile standard nei progetti Rust, puoi utilizzare uno strumento di formattazione automatica chiamato

rustfmtper formattare il tuo codice in uno stile particolare (maggiori dettagli surustfmtin Appendix D). Il team di Rust ha incluso questo strumento con la distribuzione standard di Rust, comerustc, quindi dovrebbe essere già installato sul tuo computer!

Il blocco della funzione main contiene il seguente codice:

#![allow(unused)] fn main() { println!("Hello, world!"); }

Questa linea svolge tutto il lavoro in questo piccolo programma: stampa il testo sullo schermo. Ci sono quattro dettagli importanti da notare qui.

Primo, lo stile Rust prevede di indentare con quattro spazi, non con un tab.

Secondo, println! chiama una macro Rust. Se avesse chiamato una funzione normale, sarebbe stato scritto come println (senza il !). Discuteremo in dettaglio delle macro Rust nel Capitolo 19. Per ora, devi solo sapere che usando un ! significa che stai chiamando una macro invece di una funzione normale e che le macro non seguono sempre le stesse regole delle funzioni.

Terzo, vedi la stringa "Hello, world!". Passiamo questa stringa come argomento a println!, e la stringa viene stampata sullo schermo.

Quarto, terminiamo la linea con un punto e virgola (;), che indica che questa espressione è finita e la prossima è pronta per iniziare. La maggior parte delle linee di codice Rust termina con un punto e virgola.

Compilare ed Eseguire Sono Passi Separati

Hai appena eseguito un programma appena creato, quindi esaminiamo ogni passo del processo.

Prima di eseguire un programma Rust, devi compilarlo usando il compilatore Rust inserendo il comando rustc e passandogli il nome del tuo file sorgente, in questo modo:

$ rustc main.rs

Se hai una formazione in C o C++, noterai che è simile a gcc o clang. Dopo una compilazione riuscita, Rust produce un file binario eseguibile.

Su Linux, macOS, e PowerShell su Windows, puoi vedere l'eseguibile inserendo il comando ls nel tuo shell:

$ ls

main main.rs

Su Linux e macOS, vedrai due file. Con PowerShell su Windows, vedrai gli stessi tre file che vedresti utilizzando CMD. Con CMD su Windows, dovresti inserire quanto segue:

> dir /B %= the /B option says to only show the file names =%

main.exe

main.pdb

main.rs

Questo mostra il file del codice sorgente con estensione .rs, il file eseguibile (main.exe su Windows, ma main su tutte le altre piattaforme), e, quando usi Windows, un file contenente informazioni di debug con estensione .pdb. Da qui, esegui il file main o main.exe, in questo modo:

$ ./main # o .\main.exe su Windows

Se il tuo main.rs è il tuo programma “Hello, world!”, questa linea stampa Hello, world! sul tuo terminale.

Se sei più familiare con un linguaggio dinamico, come Ruby, Python o JavaScript, potresti non essere abituato a compilare ed eseguire un programma come passi separati. Rust è un linguaggio compilato in anticipo, il che significa che puoi compilare un programma e dare l'eseguibile a qualcun altro, e loro possono eseguirlo anche senza avere Rust installato. Se dai a qualcuno un file .rb, .py, o .js, deve avere un'implementazione di Ruby, Python o JavaScript installata (rispettivamente). Ma in quei linguaggi, hai bisogno di un solo comando per compilare ed eseguire il tuo programma. Tutto è un compromesso nel design dei linguaggi.

Compilare con rustc va bene per programmi semplici, ma man mano che il progetto cresce, vorrai gestire tutte le opzioni e rendere facile condividere il tuo codice. Successivamente, ti introdurremo allo strumento Cargo, che ti aiuterà a scrivere programmi Rust nel mondo reale.

Hello, Cargo!

Cargo è il sistema di build e il gestore di pacchetti di Rust. La maggior parte dei Rustaceans utilizza questo strumento per gestire i loro progetti in Rust perché Cargo gestisce molte attività per te, come compilare il tuo codice, scaricare le librerie da cui dipende il tuo codice e costruire quelle librerie. (Chiamiamo le librerie di cui il tuo codice ha bisogno dipendenze.)

I programmi Rust più semplici, come quello che abbiamo scritto finora, non hanno dipendenze. Se avessimo costruito il progetto “Hello, world!” con Cargo, avrebbe utilizzato solo la parte di Cargo che gestisce la compilazione del codice. Man mano che scrivi programmi Rust più complessi, aggiungerai dipendenze, e se inizi un progetto utilizzando Cargo, aggiungere dipendenze sarà molto più facile.

Poiché la stragrande maggioranza dei progetti Rust utilizza Cargo, il resto di questo libro assume che tu stia usando anche Cargo. Cargo viene installato con Rust se hai utilizzato gli installer ufficiali discussi nella sezione “Installazione”. Se hai installato Rust attraverso altri mezzi, verifica se Cargo è installato inserendo quanto segue nel tuo terminale:

$ cargo --version

Se vedi un numero di versione, lo hai! Se vedi un errore, come command not found, consulta la documentazione per il tuo metodo di installazione per determinare come installare Cargo separatamente.

Creare un progetto con Cargo

Creiamo un nuovo progetto utilizzando Cargo e vediamo come differisce dal nostro progetto originale “Hello, world!”. Torna alla tua directory projects (o ovunque tu abbia deciso di memorizzare il tuo codice). Poi, su qualsiasi sistema operativo, esegui quanto segue:

$ cargo new hello_cargo

$ cd hello_cargo

Il primo comando crea una nuova directory e un progetto chiamato hello_cargo. Abbiamo chiamato il nostro progetto hello_cargo, e Cargo crea i suoi file in una directory con lo stesso nome.

Entra nella directory hello_cargo ed elenca i file. Vedrai che Cargo ha generato due file e una directory per noi: un file Cargo.toml e una directory src con un file main.rs all'interno.

Ha anche inizializzato un nuovo repository Git insieme a un file .gitignore. I file Git non verranno generati se esegui cargo new all'interno di un repository Git esistente; puoi sovrascrivere questo comportamento utilizzando cargo new --vcs=git.

Nota: Git è un sistema di controllo delle versioni comune. Puoi cambiare

cargo newper utilizzare un diverso sistema di controllo delle versioni o nessun sistema di controllo delle versioni utilizzando il flag--vcs. Eseguicargo new --helpper vedere le opzioni disponibili.

Apri Cargo.toml nel tuo editor di testo preferito. Dovrebbe sembrare simile al codice nel Listing 1-2.

[package]

name = "hello_cargo"

version = "0.1.0"

edition = "2021"

# Vedi altri chiavi e le loro definizioni su https://doc.rust-lang.org/cargo/reference/manifest.html

[dependencies]

Questo file è nel formato TOML (Tom’s Obvious, Minimal Language), che è il formato di configurazione di Cargo.

La prima riga, [package], è un'intestazione di sezione che indica che le dichiarazioni successive stanno configurando un pacchetto. Man mano che aggiungiamo più informazioni a questo file, aggiungeremo altre sezioni.

Le tre righe successive impostano le informazioni di configurazione di cui Cargo ha bisogno per compilare il tuo programma: il nome, la versione e l'edizione di Rust da utilizzare. Parleremo della chiave edition nell'Appendice E.

L'ultima riga, [dependencies], è l'inizio di una sezione per elencare tutte le dipendenze del tuo progetto. In Rust, i pacchetti di codice sono indicati come crates. Non avremo bisogno di altri crates per questo progetto, ma li useremo nel primo progetto nel Capitolo 2, quindi useremo questa sezione delle dipendenze allora.

Ora apri src/main.rs e dai un'occhiata:

Nome del file: src/main.rs

fn main() { println!("Hello, world!"); }

Cargo ha generato un programma “Hello, world!” per te, proprio come quello che abbiamo scritto nel Listing 1-1! Finora, le differenze tra il nostro progetto e il progetto generato da Cargo sono che Cargo ha inserito il codice nella directory src e abbiamo un file di configurazione Cargo.toml nella directory principale.

Cargo si aspetta che i tuoi file sorgente si trovino all'interno della directory src. La directory del progetto di livello superiore è solo per i file README, le informazioni sulla licenza, i file di configurazione e qualsiasi altra cosa non correlata al tuo codice. Utilizzare Cargo ti aiuta a organizzare i tuoi progetti. C'è un posto per tutto e tutto è al suo posto.

Se hai iniziato un progetto che non utilizza Cargo, come abbiamo fatto con il progetto “Hello, world!”, puoi convertirlo in un progetto che utilizza Cargo. Sposta il codice del progetto nella directory src e crea un file Cargo.toml appropriato. Un modo semplice per ottenere quel file Cargo.toml è eseguire cargo init, che lo creerà automaticamente per te.

Compilare ed eseguire un progetto Cargo

Ora vediamo cosa è diverso quando costruiamo ed eseguiamo il programma “Hello, world!” con Cargo! Dalla tua directory hello_cargo, costruisci il tuo progetto inserendo il seguente comando:

$ cargo build

Compiling hello_cargo v0.1.0 (file:///projects/hello_cargo)

Finished dev [unoptimized + debuginfo] target(s) in 2.85 secs

Questo comando crea un file eseguibile in target/debug/hello_cargo (o target\debug\hello_cargo.exe su Windows) invece che nella tua directory corrente. Poiché la build predefinita è una build di debug, Cargo mette il binario in una directory chiamata debug. Puoi eseguire l'eseguibile con questo comando:

$ ./target/debug/hello_cargo # o .\target\debug\hello_cargo.exe su Windows

Hello, world!

Se tutto va bene, Hello, world! dovrebbe stampare nel terminale. Eseguire cargo build per la prima volta causa anche la creazione da parte di Cargo di un nuovo file a livello superiore: Cargo.lock. Questo file tiene traccia delle versioni esatte delle dipendenze nel tuo progetto. Questo progetto non ha dipendenze, quindi il file è un po' scarno. Non sarà mai necessario modificare manualmente questo file; Cargo gestisce i suoi contenuti per te.

Abbiamo appena costruito un progetto con cargo build e lo abbiamo eseguito con ./target/debug/hello_cargo, ma possiamo anche usare cargo run per compilare il codice e poi eseguire l'eseguibile risultante tutto in un comando:

$ cargo run

Finished dev [unoptimized + debuginfo] target(s) in 0.0 secs

Running `target/debug/hello_cargo`

Hello, world!

Usare cargo run è più conveniente che dover ricordare di eseguire cargo build e poi usare l'intero percorso al binario, quindi la maggior parte degli sviluppatori utilizza cargo run.

Nota che questa volta non abbiamo visto un output che indica che Cargo stava compilando hello_cargo. Cargo ha capito che i file non erano cambiati, quindi non ha ricompilato ma ha solo eseguito il binario. Se avevi modificato il tuo codice sorgente, Cargo avrebbe ricostruito il progetto prima di eseguirlo e avresti visto questo output:

$ cargo run

Compiling hello_cargo v0.1.0 (file:///projects/hello_cargo)

Finished dev [unoptimized + debuginfo] target(s) in 0.33 secs

Running `target/debug/hello_cargo`

Hello, world!

Cargo fornisce anche un comando chiamato cargo check. Questo comando controlla rapidamente il tuo codice per assicurarsi che compili ma non produce un eseguibile:

$ cargo check

Checking hello_cargo v0.1.0 (file:///projects/hello_cargo)

Finished dev [unoptimized + debuginfo] target(s) in 0.32 secs

Perché non vorresti un eseguibile? Spesso, cargo check è molto più veloce di cargo build perché salta il passaggio di produzione di un eseguibile. Se stai controllando continuamente il tuo lavoro mentre scrivi il codice, usare cargo check accelererà il processo di farti sapere se il tuo progetto è ancora compilabile! Per questo motivo, molti Rustacean eseguono cargo check periodicamente mentre scrivono il loro programma per assicurarsi che compili. Poi eseguono cargo build quando sono pronti per utilizzare l'eseguibile.

Riassumiamo ciò che abbiamo imparato finora su Cargo:

- Possiamo creare un progetto usando

cargo new. - Possiamo costruire un progetto usando

cargo build. - Possiamo costruire ed eseguire un progetto in un solo passaggio usando

cargo run. - Possiamo costruire un progetto senza produrre un binario per controllare gli errori usando

cargo check. - Invece di salvare il risultato della build nella stessa directory del nostro codice, Cargo lo memorizza nella directory target/debug.

Un ulteriore vantaggio dell'utilizzare Cargo è che i comandi sono gli stessi indipendentemente dal sistema operativo su cui stai lavorando. Quindi, a questo punto, non forniremo più istruzioni specifiche per Linux e macOS rispetto a Windows.

Compilare per il rilascio

Quando il tuo progetto è finalmente pronto per il rilascio, puoi usare cargo build --release per compilarlo con ottimizzazioni. Questo comando creerà un eseguibile in target/release invece di target/debug. Le ottimizzazioni fanno sì che il tuo codice Rust venga eseguito più velocemente, ma accenderle allunga il tempo necessario per compilare il tuo programma. Questo è il motivo per cui ci sono due profili diversi: uno per lo sviluppo, quando vuoi ricostruire rapidamente e spesso, e un altro per costruire il programma finale che darai a un utente che non verrà ricostruito ripetutamente e che verrà eseguito il più rapidamente possibile. Se stai facendo benchmark sui tempi di esecuzione del tuo codice, assicurati di eseguire cargo build --release e fare benchmark con l'eseguibile in target/release.

Cargo come convenzione

Con progetti semplici, Cargo non offre molto valore rispetto all'utilizzo di rustc, ma dimostrerà il suo valore man mano che i tuoi programmi diventeranno più intricati. Una volta che i programmi crescono in file multipli o necessitano di una dipendenza, è molto più facile lasciare che Cargo coordini la build.

Sebbene il progetto hello_cargo sia semplice, ora utilizza gran parte degli strumenti reali che utilizzerai nel resto della tua carriera in Rust. Infatti, per lavorare su qualsiasi progetto esistente, puoi usare i seguenti comandi per controllare il codice usando Git, cambiare nella directory di quel progetto e costruire:

$ git clone example.org/someproject

$ cd someproject

$ cargo build

Per ulteriori informazioni su Cargo, consulta la sua documentazione.

Sommario

Sei già sulla buona strada nel tuo viaggio con Rust! In questo capitolo, hai imparato come:

- Installare l'ultima versione stabile di Rust utilizzando

rustup - Aggiornare a una versione più recente di Rust

- Aprire la documentazione installata localmente

- Scrivere ed eseguire un programma “Hello, world!” utilizzando

rustcdirettamente - Creare ed eseguire un nuovo progetto utilizzando le convenzioni di Cargo

Questo è un ottimo momento per costruire un programma più sostanziale per abituarti a leggere e scrivere codice Rust. Quindi, nel Capitolo 2, costruiremo un programma di gioco di indovinelli. Se preferisci iniziare imparando come funzionano i concetti di programmazione comuni in Rust, vedi il Capitolo 3 e poi torna al Capitolo 2.

Programmare un Gioco di Indovinelli

Immergiamoci in Rust lavorando insieme a un progetto pratico! Questo capitolo ti introdurrà a pochi concetti comuni di Rust mostrandoti come usarli in un programma reale. Imparerai a conoscere let, match, metodi, funzioni associate, crate esterne e altro ancora! Nei capitoli successivi, esploreremo queste idee in maggior dettaglio. In questo capitolo, eserciterai solo le basi.

Implementeremo un classico problema di programmazione per principianti: un gioco di indovinelli. Ecco come funziona: il programma genererà un intero casuale tra 1 e 100. Chiederà quindi al giocatore di inserire un indovinello. Dopo che un indovinello è stato inserito, il programma indicherà se l'indovinello è troppo basso o troppo alto. Se l'indovinello è corretto, il gioco stamperà un messaggio di congratulazioni ed uscirà.

Configurazione di un Nuovo Progetto

Per configurare un nuovo progetto, vai alla directory projects che hai creato nel Capitolo 1 e crea un nuovo progetto usando Cargo, come segue:

$ cargo new guessing_game

$ cd guessing_game

Il primo comando, cargo new, prende il nome del progetto (guessing_game) come primo argomento. Il secondo comando cambia nella directory del nuovo progetto.

Guarda il file Cargo.toml generato:

Nome del file: Cargo.toml

[package]

name = "guessing_game"

version = "0.1.0"

edition = "2021"

# See more keys and their definitions at https://doc.rust-lang.org/cargo/reference/manifest.html

[dependencies]

Come hai visto nel Capitolo 1, cargo new genera un programma “Hello, world!” per te. Controlla il file src/main.rs:

Nome del file: src/main.rs

fn main() { println!("Hello, world!"); }

Ora compiliamo questo programma “Hello, world!” ed eseguiamolo nello stesso passaggio usando il comando cargo run:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished dev [unoptimized + debuginfo] target(s) in 1.50s

Running `target/debug/guessing_game`

Hello, world!

Il comando run è utile quando hai bisogno di iterare rapidamente su un progetto, come faremo in questo gioco, testando rapidamente ogni iterazione prima di passare alla successiva.

Riapri il file src/main.rs. Scriverai tutto il codice in questo file.

Elaborare un Indovinello

La prima parte del programma del gioco di indovinelli chiederà l'input dell'utente, elaborerà quell'input e verificherà che l'input sia nella forma prevista. Per iniziare, permetteremo al giocatore di inserire un indovinello. Inserisci il codice nell'Elenco 2-1 in src/main.rs.

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Questo codice contiene molte informazioni, quindi esaminiamolo riga per riga. Per ottenere l'input dell'utente e poi stampare il risultato come output, dobbiamo portare la libreria io di input/output nello Scope. La libreria io proviene dalla libreria standard, conosciuta come std:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Per default, Rust ha un insieme di elementi definiti nella libreria standard che porta nello Scope di ogni programma. Questo insieme è chiamato prelude, e puoi vedere tutto ciò che contiene nella documentazione della libreria standard.

Se un tipo che vuoi usare non è nel prelude, devi portare esplicitamente quel tipo nello Scope con un'istruzione use. Usare la libreria std::io ti fornisce una serie di funzionalità utili, inclusa la possibilità di accettare input dall'utente.

Come hai visto nel Capitolo 1, la funzione main è il punto di ingresso nel programma:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}La sintassi fn dichiara una nuova funzione; le parentesi tonde, (), indicano che non ci sono parametri; e la parentesi graffa, {, inizia il Blocco della funzione.

Come hai anche imparato nel Capitolo 1, println! è una macro che stampa una stringa a schermo:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Questo codice sta stampando un prompt che dichiara cosa sia il gioco e richiede un input dall'utente.

Memorizzare Valori con le Variabili

Successivamente, creeremo una variabile per memorizzare l'input dell'utente, come segue:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Ora il programma diventa interessante! C'è molto in corso in questa piccola riga. Usiamo l'istruzione let per creare la variabile. Ecco un altro esempio:

let apples = 5;Questa linea crea una nuova variabile chiamata apples e la associa al valore 5. In Rust, le variabili sono immutabili per default, il che significa che una volta assegnato un valore alla variabile, questo valore non cambierà. Discuteremo questo concetto in dettaglio nella sezione “Variabili e Mutabilità” nel Capitolo 3. Per rendere una variabile mutabile, aggiungiamo mut prima del nome della variabile:

let apples = 5; // immutabile

let mut bananas = 5; // mutabileNota: La sintassi

//inizia un commento che continua fino alla fine della linea. Rust ignora tutto nei commenti. Discuteremo i commenti in modo più dettagliato nel Capitolo 3.

Tornando al programma del gioco di indovinelli, ora sai che let mut guess introdurrà una variabile mutabile chiamata guess. Il segno di uguale (=) dice a Rust che vogliamo associare qualcosa alla variabile ora. A destra del segno di uguale c'è il valore a cui guess è associato, ovvero il risultato della chiamata a String::new, una funzione che restituisce una nuova istanza di una String.

String è un tipo di stringa fornito dalla libreria standard che è un testo UTF-8 codificato espandibile.

La sintassi :: nella linea ::new indica che new è una funzione associata del tipo String. Una funzione associata è una funzione che è implementata su un tipo, in questo caso String. Questa funzione new crea una nuova stringa vuota. Troverai una funzione new su molti tipi perché è un nome comune per una funzione che crea un nuovo valore di qualche tipo.

In sintesi, la linea let mut guess = String::new(); ha creato una variabile mutabile che è attualmente associata a una nuova istanza vuota di una String. Uff!

Ricevere Input dall'Utente

Ricordati che abbiamo incluso la funzionalità di input/output dalla libreria standard con use std::io; nella prima linea del programma. Ora chiameremo la funzione stdin dal modulo io, il quale ci permetterà di gestire l'input dell'utente:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Se non avessimo importato la libreria io con use std::io; all'inizio del programma, potremmo ancora usare la funzione scrivendo questa chiamata di funzione come std::io::stdin. La funzione stdin restituisce un'istanza di std::io::Stdin, che è un tipo che rappresenta un handle per l'input standard del tuo terminale.

Successivamente, la riga .read_line(&mut guess) chiama il metodo read_line sull'handle di input standard per ottenere l'input dall'utente. Passiamo anche &mut guess come argomento a read_line per dirgli in quale stringa memorizzare l'input dell'utente. Il lavoro completo di read_line è prendere qualsiasi cosa l'utente digiti nell'input standard e appenderla a una stringa (senza sovrascrivere il suo contenuto), quindi passiamo quella stringa come argomento. La stringa ha bisogno di essere mutabile affinché il metodo possa cambiare il contenuto della stringa.

Il & indica che questo argomento è una referenza, che ti dà un modo di far accedere parti multiple del tuo codice a un pezzo di dati senza doverne copiare i dati in memoria più volte. Le referenze sono una caratteristica complessa e uno dei maggiori vantaggi di Rust è quanto sia sicuro e facile usare le referenze. Non hai bisogno di sapere molti di quei dettagli per completare questo programma. Per ora, tutto ciò che devi sapere è che, come le variabili, le referenze sono immutabili per default. Pertanto, devi scrivere &mut guess piuttosto che &guess per renderla mutabile. (Il Capitolo 4 spiegherà le referenze in modo più approfondito.)

Gestire il Potenziale Fallimento con Result

Stiamo ancora lavorando su questa riga di codice. Ora stiamo discutendo una terza riga di testo, ma nota che fa ancora parte di una singola riga logica di codice. La parte successiva di questo metodo è:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Avremmo potuto scrivere questo codice come:

io::stdin().read_line(&mut guess).expect("Failed to read line");Tuttavia, una riga lunga è difficile da leggere, quindi è meglio dividerla. È spesso saggio introdurre un nuovo riga e altri spazi bianchi per aiutare a spezzare righe lunghe quando chiami un metodo con la sintassi .method_name(). Ora discutiamo cosa fa questa linea.

Come menzionato prima, read_line mette qualsiasi cosa l'utente inserisca nella stringa che passiamo ad essa, ma restituisce anche un valore Result. Result è un enumeration, spesso chiamato enum, che è un tipo che può essere in uno di molti stati possibili. Chiamiamo ciascun stato possibile una variante.

Il Capitolo 6 coprirà gli enum in modo più dettagliato. Lo scopo di questi tipi Result è codificare le informazioni sulla gestione degli errori.

Le varianti di Result sono Ok ed Err. La variante Ok indica che l'operazione è stata eseguita con successo, e dentro Ok c'è il valore generato con successo. La variante Err significa che l'operazione è fallita, e Err contiene informazioni su come o perché l'operazione è fallita.

Valori del tipo Result, come valori di qualsiasi tipo, hanno metodi definiti su di loro. Un'istanza di Result ha un metodo expect che puoi chiamare. Se questa istanza di Result è un valore Err, expect farà sì che il programma si arresti e visualizzi il messaggio che hai passato come argomento a expect. Se il metodo read_line restituisce un Err, è probabile che sia il risultato di un errore proveniente dal sistema operativo sottostante. Se questa istanza di Result è un valore Ok, expect prenderà il valore di ritorno che Ok sta trattenendo e restituirà solo quel valore a te in modo che tu possa usarlo. In questo caso, quel valore è il numero di byte nell'input dell'utente.

Se non chiami expect, il programma si compila, ma otterrai un avvertimento:

$ cargo build

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

warning: unused `Result` that must be used

--> src/main.rs:10:5

|

10 | io::stdin().read_line(&mut guess);

| ^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^

|

= note: this `Result` may be an `Err` variant, which should be handled

= note: `#[warn(unused_must_use)]` on by default

warning: `guessing_game` (bin "guessing_game") generated 1 warning

Finished dev [unoptimized + debuginfo] target(s) in 0.59s

Rust avverte che non hai utilizzato il valore Result restituito da read_line, indicando che il programma non ha gestito un possibile errore.

Il modo giusto per eliminare l'avviso è scrivere effettivamente codice di gestione degli errori, ma nel nostro caso vogliamo solo che questo programma si arresti quando si verifica un problema, quindi possiamo usare expect. Imparerai a recuperare da errori nel Capitolo 9.

Stampare Valori con i Segnaposto di println!

A parte la parentesi graffa di chiusura, c'è solo un'altra riga di cui discutere nel codice finora:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Questa riga stampa la stringa che ora contiene l'input dell'utente. Il set di parentesi graffe {} è un segnaposto: pensa a {} come piccole chele che tengono un valore in posizione. Quando si stampa il valore di una variabile, il nome della variabile può andare dentro le parentesi graffe. Quando si stampa il risultato di una espressione, posiziona parentesi graffe vuote nella stringa di formato, quindi segui la stringa di formato con un elenco separato da virgole di espressioni da stampare in ogni segnaposto di parentesi graffe vuoto nello stesso ordine. Stampare una variabile e il risultato di un'espressione in una chiamata a println! apparirebbe così:

#![allow(unused)] fn main() { let x = 5; let y = 10; println!("x = {x} and y + 2 = {}", y + 2); }

Questo codice stamperebbe x = 5 and y + 2 = 12.

Testare la Prima Parte

Testiamo la prima parte del gioco di indovinelli. Eseguilo usando cargo run:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished dev [unoptimized + debuginfo] target(s) in 6.44s

Running `target/debug/guessing_game`

Guess the number!

Please input your guess.

6

You guessed: 6

A questo punto, la prima parte del gioco è finita: stiamo ottenendo input dalla tastiera e poi lo stampiamo.

Generare un Numero Segreto

Successivamente, dobbiamo generare un numero segreto che l'utente tenterà di indovinare. Il numero segreto dovrebbe essere diverso ogni volta affinché il gioco sia divertente da giocare più di una volta. Useremo un numero casuale tra 1 e 100 in modo che il gioco non sia troppo difficile. Rust non include ancora funzionalità di numeri casuali nella sua libreria standard. Tuttavia, il team di Rust fornisce un crate rand con tale funzionalità.

Usare un Crate per Ottenere Maggiori Funzionalità

Ricorda che un crate è una raccolta di file di codice sorgente Rust. Il progetto su cui abbiamo lavorato è un crate binario, che è un eseguibile. Il crate rand è un crate libreria, che contiene codice destinato a essere utilizzato in altri programmi e non può essere eseguito da solo.

Il coordinamento dei crate esterni da parte di Cargo è dove Cargo brilla davvero. Prima di poter scrivere codice che utilizza rand, dobbiamo modificare il file Cargo.toml per includere il crate rand come dipendenza. Apri quel file ora e aggiungi la seguente riga in fondo, sotto l'intestazione della sezione [dependencies] che Cargo ha creato per te. Assicurati di specificare rand esattamente come abbiamo fatto qui, con questo numero di versione, altrimenti i codici di esempio in questo tutorial potrebbero non funzionare:

Nome del file: Cargo.toml

[dependencies]

rand = "0.8.5"

Nel file Cargo.toml, tutto ciò che segue un'intestazione fa parte di quella sezione che continua fino a quando non inizia un'altra sezione. In [dependencies] indichi a Cargo da quali crate esterni il tuo progetto dipende e quali versioni di quei crate richiedi. In questo caso, specifichiamo il crate rand con lo specificatore di versione semantica 0.8.5. Cargo comprende il Versionamento Semantico (a volte chiamato SemVer), che è uno standard per scrivere numeri di versione. Lo specificatore 0.8.5 è in realtà un'abbreviazione per ^0.8.5, il che significa qualsiasi versione che sia almeno 0.8.5 ma inferiore a 0.9.0.

Cargo considera queste versioni come aventi API pubbliche compatibili con la versione 0.8.5, e questa specifica garantisce che otterrai l'ultima release di patch che continuerà a compilare con il codice in questo capitolo. Qualsiasi versione 0.9.0 o successiva non è garantita per avere la stessa API di quanto utilizzato nei seguenti esempi.

Ora, senza cambiare nessuno del codice, costruiamo il progetto, come mostrato nel Listing 2-2.

$ cargo build

Updating crates.io index

Downloaded rand v0.8.5

Downloaded libc v0.2.127

Downloaded getrandom v0.2.7

Downloaded cfg-if v1.0.0

Downloaded ppv-lite86 v0.2.16

Downloaded rand_chacha v0.3.1

Downloaded rand_core v0.6.3

Compiling libc v0.2.127

Compiling getrandom v0.2.7

Compiling cfg-if v1.0.0

Compiling ppv-lite86 v0.2.16

Compiling rand_core v0.6.3

Compiling rand_chacha v0.3.1

Compiling rand v0.8.5

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished dev [unoptimized + debuginfo] target(s) in 2.53s

Potresti vedere numeri di versione diversi (ma saranno tutti compatibili con il codice, grazie a SemVer!) e linee diverse (a seconda del sistema operativo), e le linee potrebbero essere in un ordine diverso.

Quando includiamo una dipendenza esterna, Cargo recupera le ultime versioni di tutto ciò che quella dipendenza necessita dal registro, che è una copia dei dati da Crates.io. Crates.io è dove le persone nell'ecosistema Rust pubblicano i loro progetti Rust open source affinché altri possano utilizzarli.

Dopo aver aggiornato il registro, Cargo controlla la sezione [dependencies] e scarica qualsiasi crate elencato che non è già stato scaricato. In questo caso, sebbene abbiamo elencato solo rand come dipendenza, Cargo ha preso anche altri crate da cui rand dipende per funzionare. Dopo aver scaricato i crate, Rust li compila e poi compila il progetto con le dipendenze disponibili.

Se esegui immediatamente cargo build di nuovo senza apportare modifiche, non otterrai alcun output a parte la linea Finished. Cargo sa già di aver scaricato e compilato le dipendenze e tu non hai cambiato nulla su di esse nel tuo file Cargo.toml. Cargo sa anche che non hai cambiato nulla sul tuo codice, quindi non lo ricompila nemmeno. Con nulla da fare, semplicemente si chiude.

Se apri il file src/main.rs, fai una modifica banale, poi lo salvi e lo compili di nuovo, vedrai solo due righe di output:

$ cargo build

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished dev [unoptimized + debuginfo] target(s) in 2.53 secs

Queste righe mostrano che Cargo aggiorna solo la build con la tua piccola modifica al file src/main.rs. Le tue dipendenze non sono cambiate, quindi Cargo sa che può riutilizzare ciò che ha già scaricato e compilato per quelle.

Garantire Build Riproducibili con il File Cargo.lock

Cargo ha un meccanismo che garantisce che tu possa ricostruire lo stesso artefatto ogni volta che tu o chiunque altro costruisce il tuo codice: Cargo utilizzerà solo le versioni delle dipendenze che hai specificato finché non indichi altrimenti. Ad esempio, supponiamo che la prossima settimana venga rilasciata la versione 0.8.6 del crate rand e che quella versione contenga una correzione di bug importante, ma contenga anche una regressione che romperà il tuo codice. Per gestire ciò, Rust crea il file Cargo.lock la prima volta che esegui cargo build, quindi ora abbiamo questo nella directory guessing_game.

Quando costruisci un progetto per la prima volta, Cargo determina tutte le versioni delle dipendenze che soddisfano i criteri e poi le scrive nel file Cargo.lock. Quando costruisci il tuo progetto in futuro, Cargo vedrà che il file Cargo.lock esiste e utilizzerà le versioni specificate lì piuttosto che fare tutto il lavoro di determinare di nuovo le versioni. Questo ti consente di avere una build riproducibile automaticamente. In altre parole, il tuo progetto rimarrà a 0.8.5 finché non effettui un aggiornamento esplicito, grazie al file Cargo.lock. Poiché il file Cargo.lock è importante per le build riproducibili, spesso viene inserito nel controllo del codice sorgente insieme al resto del codice nel tuo progetto.

Aggiornare un Crate per Ottenere una Nuova Versione

Quando vuoi veramente aggiornare un crate, Cargo fornisce il comando update, che ignorerà il file Cargo.lock e determinerà tutte le ultime versioni che soddisfano le tue specifiche in Cargo.toml. Cargo scriverà poi quelle versioni nel file Cargo.lock. In questo caso, Cargo cercherà solo versioni maggiori di 0.8.5 e minori di 0.9.0. Se il crate rand ha rilasciato le due nuove versioni 0.8.6 e 0.9.0, vedresti quanto segue se eseguissi cargo update:

$ cargo update

Updating crates.io index

Updating rand v0.8.5 -> v0.8.6

Cargo ignora il rilascio della 0.9.0. A questo punto, noteresti anche un cambiamento nel tuo file Cargo.lock che indica che la versione del crate rand che stai usando ora è 0.8.6. Per usare la versione 0.9.0 di rand o qualsiasi versione nella serie 0.9.x, dovresti aggiornare il file Cargo.toml in modo che assomigli a questo:

[dependencies]

rand = "0.9.0"

La prossima volta che eseguirai cargo build, Cargo aggiornerà il registro dei crate disponibili e rivaluterà le tue richieste rand secondo la nuova versione che hai specificato.

Ci sarebbe molto altro da dire su Cargo e il suo ecosistema, di cui discuteremo nel Capitolo 14, ma per ora, questo è tutto ciò che devi sapere. Cargo rende molto facile riutilizzare le librerie, quindi i Rustaceans sono in grado di scrivere progetti più piccoli che sono assemblati da diversi pacchetti.

Generazione di un Numero Casuale

Iniziamo a utilizzare rand per generare un numero da indovinare. Il passo successivo è aggiornare src/main.rs, come mostrato nel Listing 2-3.

use std::io;

use rand::Rng;

fn main() {

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("The secret number is: {secret_number}");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Per prima cosa aggiungiamo la linea use rand::Rng;. Il Rng trait definisce metodi che i generatori di numeri casuali implementano, e questo trait deve essere nello Scope affinché possiamo utilizzare quei metodi. Il Capitolo 10 tratterà i trait in dettaglio.

Successivamente, stiamo aggiungendo due righe nel mezzo. Nella prima riga, chiamiamo la funzione rand::thread_rng che ci fornisce il particolare generatore di numeri casuali che stiamo per utilizzare: uno che è locale al thread di esecuzione corrente ed è seminato dal sistema operativo. Poi chiamiamo il metodo gen_range sul generatore di numeri casuali. Questo metodo è definito dal trait Rng che abbiamo portato nello Scope con l'istruzione use rand::Rng;. Il metodo gen_range prende un'espressione di intervallo come argomento e genera un numero casuale nell'intervallo. Il tipo di espressione di intervallo che stiamo utilizzando qui ha la forma start..=end ed è inclusivo sui limiti inferiore e superiore, quindi dobbiamo specificare 1..=100 per richiedere un numero tra 1 e 100.

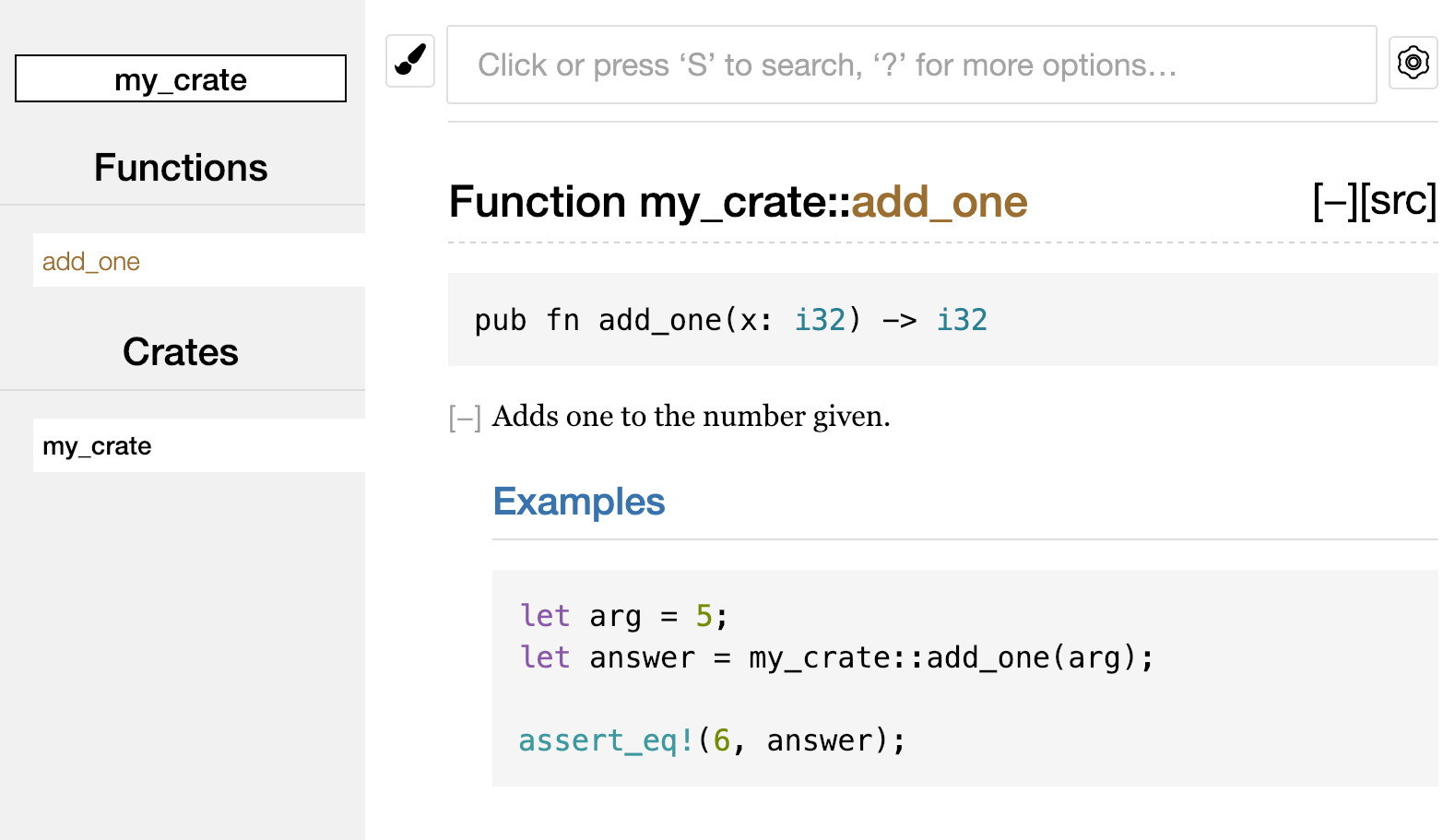

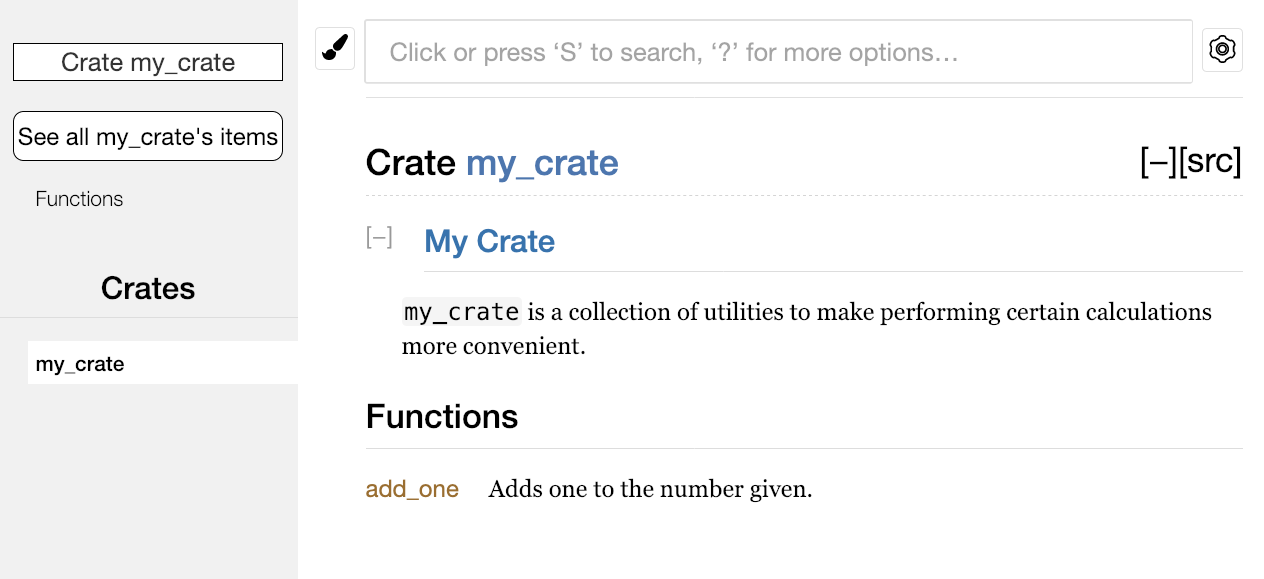

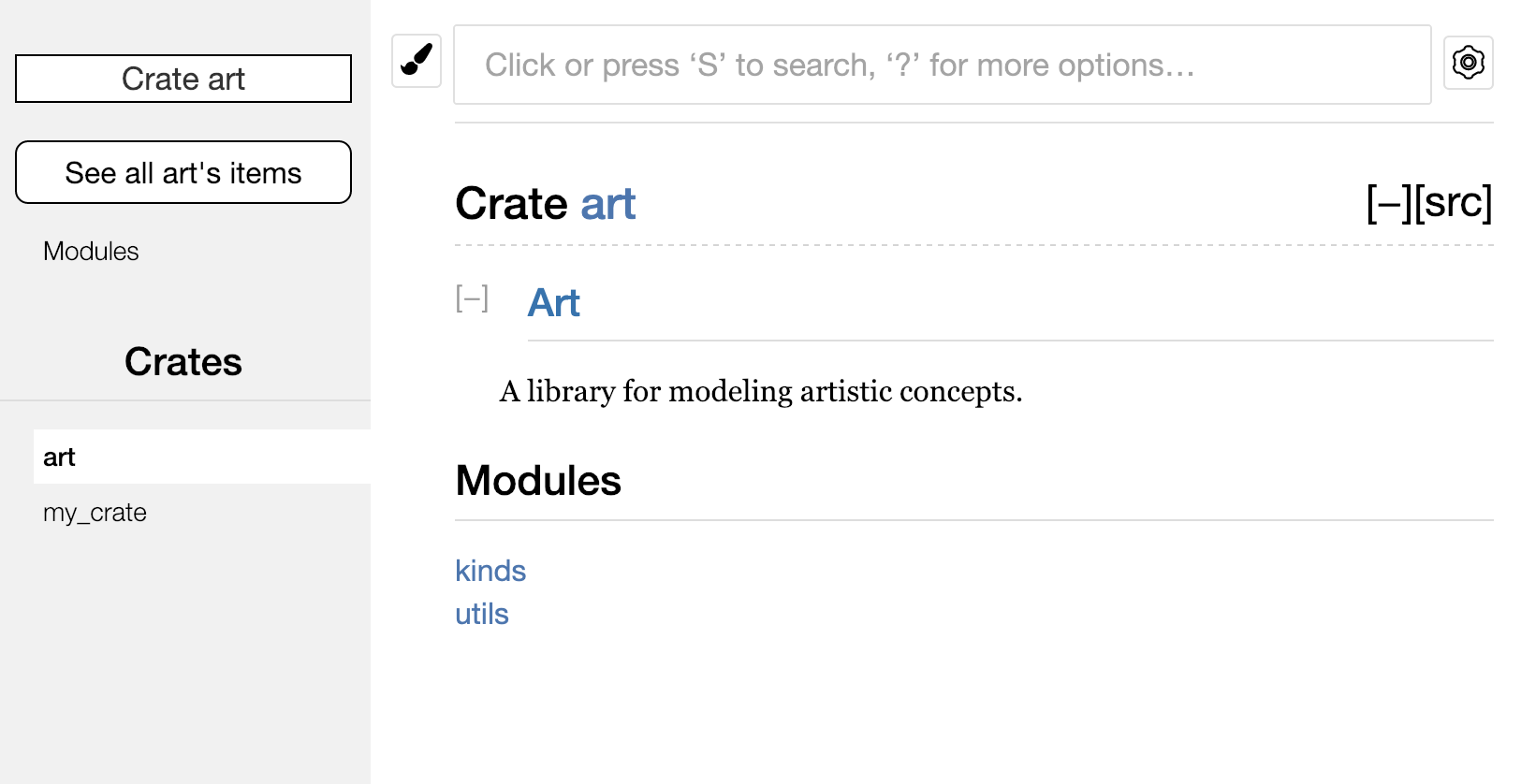

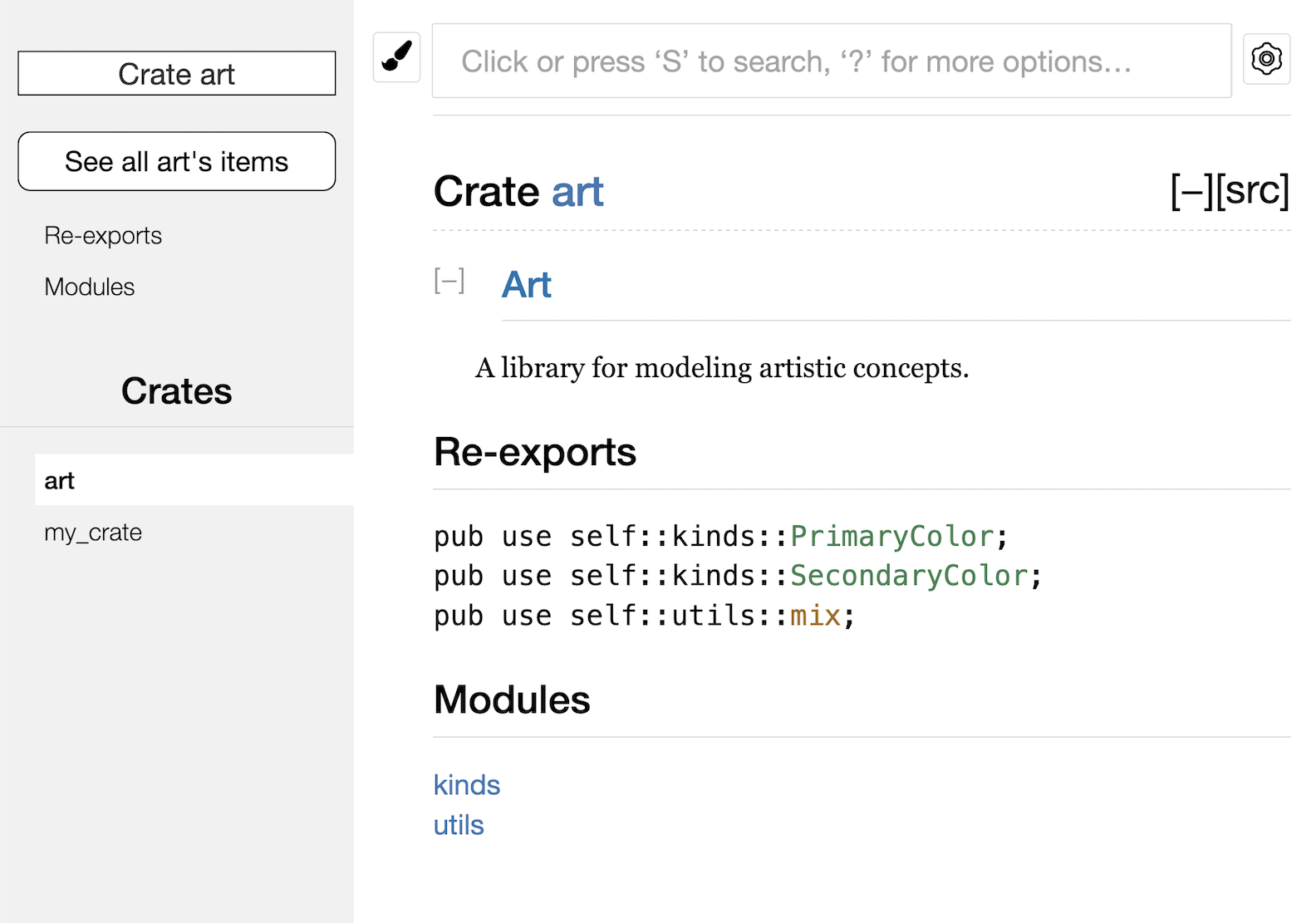

Nota: Non saprai semplicemente quali trait usare e quali metodi e funzioni chiamare da un crate, quindi ogni crate ha documentazione con istruzioni per utilizzarlo. Un'altra caratteristica interessante di Cargo è che eseguire il comando

cargo doc --opencostruirà la documentazione fornita da tutte le tue dipendenze localmente e la aprirà nel tuo browser. Se sei interessato ad altre funzionalità nel craterand, ad esempio, eseguicargo doc --opene clicca surandnella barra laterale a sinistra.

La seconda nuova linea stampa il numero segreto. Questo è utile mentre stiamo sviluppando il programma per poterlo testare, ma lo elimineremo dalla versione finale. Non è molto un gioco se il programma stampa la risposta appena inizia!

Prova a eseguire il programma alcune volte:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished dev [unoptimized + debuginfo] target(s) in 2.53s

Running `target/debug/guessing_game`

Guess the number!

The secret number is: 7

Please input your guess.

4

You guessed: 4

$ cargo run

Finished dev [unoptimized + debuginfo] target(s) in 0.02s

Running `target/debug/guessing_game`

Guess the number!

The secret number is: 83

Please input your guess.

5

You guessed: 5

Dovresti ottenere numeri casuali diversi, e dovrebbero essere tutti numeri tra 1 e 100. Ottimo lavoro!

Confrontare l'Indovinello con il Numero Segreto

Ora che abbiamo l'input dell'utente e un numero casuale, possiamo confrontarli. Quel passaggio è mostrato nel Listing 2-4. Nota che questo codice non sarà ancora compilabile, come spiegheremo.

use rand::Rng;

use std::cmp::Ordering;

use std::io;

fn main() {

// --snip--

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("The secret number is: {secret_number}");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

match guess.cmp(&secret_number) {

Ordering::Less => println!("Too small!"),

Ordering::Greater => println!("Too big!"),

Ordering::Equal => println!("You win!"),

}

}Per prima cosa aggiungiamo un'altra istruzione use, portando un tipo chiamato std::cmp::Ordering nello Scope dalla libreria standard. Il tipo Ordering è un altro enum e ha le varianti Less, Greater, e Equal. Questi sono i tre risultati possibili quando confronti due valori.

Poi aggiungiamo cinque nuove righe in basso che utilizzano il tipo Ordering. Il metodo cmp confronta due valori e può essere chiamato su qualsiasi cosa che possa essere confrontata. Prende un riferimento a qualsiasi cosa vuoi confrontare: qui sta confrontando guess con secret_number. Poi restituisce una variante dell'enum Ordering che abbiamo portato nello Scope con l'istruzione use. Utilizziamo un'espressione match per decidere cosa fare successivamente in base a quale variante di Ordering è stata restituita dalla chiamata a cmp con i valori in guess e secret_number.

Un'espressione match è costituita da Rami. Un Ramo consiste in un Pattern da abbinare e il codice che dovrebbe essere eseguito se il valore dato a match si adatta a quel Pattern del Ramo. Rust prende il valore dato a match e controlla ciascun Pattern del Ramo a turno. I Pattern e il costrutto match sono potenti caratteristiche di Rust: ti permettono di esprimere una varietà di situazioni che il tuo codice potrebbe incontrare e ti assicurano di gestirle tutte. Queste caratteristiche saranno trattate in dettaglio nel Capitolo 6 e nel Capitolo 18, rispettivamente.

Vediamo un esempio con l'espressione match che utilizziamo qui. Supponiamo che l'utente abbia indovinato 50 e che il numero segreto generato casualmente questa volta sia 38.

Quando il codice confronta 50 con 38, il metodo cmp restituirà Ordering::Greater perché 50 è maggiore di 38. L'espressione match ottiene il valore Ordering::Greater e inizia a verificare ogni Pattern del Ramo. Guarda il Pattern del primo Ramo, Ordering::Less, e vede che il valore Ordering::Greater non corrisponde a Ordering::Less, quindi ignora il codice in quel Ramo e passa al prossimo Ramo. Il Pattern del prossimo Ramo è Ordering::Greater, che corrisponde a Ordering::Greater! Il codice associato in quel Ramo sarà eseguito e stamperà Too big! sullo schermo. L'espressione match termina dopo la prima corrispondenza riuscita, quindi non esaminerà l'ultimo Ramo in questo scenario.

Tuttavia, il codice nel Listing 2-4 non sarà ancora compilabile. Proviamo:

$ cargo build

Compiling libc v0.2.86

Compiling getrandom v0.2.2

Compiling cfg-if v1.0.0

Compiling ppv-lite86 v0.2.10

Compiling rand_core v0.6.2

Compiling rand_chacha v0.3.0

Compiling rand v0.8.5

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

error[E0308]: mismatched types

--> src/main.rs:22:21

|

22 | match guess.cmp(&secret_number) {

| --- ^^^^^^^^^^^^^^ expected struct `String`, found integer

| |

| arguments to this function are incorrect

|

= note: expected reference `&String`

found reference `&{integer}`

note: associated function defined here

--> /rustc/d5a82bbd26e1ad8b7401f6a718a9c57c96905483/library/core/src/cmp.rs:783:8

For more information about this error, try `rustc --explain E0308`.

error: could not compile `guessing_game` due to previous error

Il nucleo dell'errore afferma che ci sono tipi non corrispondenti. Rust ha un sistema tipologico forte e statico. Tuttavia, ha anche la determinazione del tipo. Quando abbiamo scritto let mut guess = String::new(), Rust è stato in grado di inferire che guess dovrebbe essere un String e non ci ha costretti a scrivere il tipo. D'altra parte, secret_number è un tipo numerico. Alcuni tipi numerici di Rust possono avere un valore tra 1 e 100: i32, un numero a 32 bit; u32, un numero Unsigned a 32 bit; i64, un numero a 64 bit; oltre ad altri. A meno che non sia specificato diversamente, Rust predefinisce un i32, che è il tipo di secret_number a meno che tu non aggiunga informazioni di tipo altrove che farebbero inferire a Rust un tipo numerico diverso. La ragione dell'errore è che Rust non può confrontare una stringa e un tipo numerico.

Alla fine, vogliamo convertire il String che il programma legge come input in un tipo numerico in modo da poterlo confrontare numericamente con il numero segreto. Lo facciamo aggiungendo questa riga al Blocco della funzione main:

Nome file: src/main.rs

use rand::Rng;

use std::cmp::Ordering;

use std::io;

fn main() {

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("The secret number is: {secret_number}");

println!("Please input your guess.");

// --snip--

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

let guess: u32 = guess.trim().parse().expect("Please type a number!");

println!("You guessed: {guess}");

match guess.cmp(&secret_number) {

Ordering::Less => println!("Too small!"),

Ordering::Greater => println!("Too big!"),

Ordering::Equal => println!("You win!"),

}

}La linea è:

let guess: u32 = guess.trim().parse().expect("Please type a number!");Creiamo una variabile chiamata guess. Ma aspetta, il programma ha già una variabile chiamata guess? Sì, ma Rust ci permette utilmente di sovrascrivere il valore precedente di guess con uno nuovo. Shadowing ci permette di riutilizzare il nome della variabile guess piuttosto che costringerci a creare due variabili uniche, come guess_str e guess, per esempio. Tratteremo questo in maggior dettaglio nel Capitolo 3, ma per ora, sappi che questa caratteristica è spesso utilizzata quando si desidera convertire un valore da un tipo a un altro tipo.

Noi leghiamo questa nuova variabile all'espressione guess.trim().parse(). Il guess

nell'espressione si riferisce alla variabile guess originale che conteneva

l'input come stringa. Il metodo trim su un'istanza di String eliminerà qualsiasi

spazio bianco all'inizio e alla fine, cosa che dobbiamo fare per poter confrontare la

stringa con il u32, che può contenere solo dati numerici. L'utente deve premere

invio per soddisfare read_line e inserire il loro guess, che aggiunge un

carattere di nuova linea alla stringa. Ad esempio, se l'utente digita 5 e

preme invio, guess appare così: 5\n. Il \n rappresenta

“newline.” (Su Windows, premendo invio risulta in un ritorno a capo

e un newline, \r\n.) Il metodo trim elimina \n o \r\n, risultando

in solo 5.

Il metodo parse sulle stringhe converte una stringa in

un altro tipo. Qui, lo usiamo per convertire da una stringa a un numero. Dobbiamo

dire a Rust esattamente il tipo di numero che vogliamo usando let guess: u32. Il duepunti

(:) dopo guess dice a Rust che annoteremo il tipo della variabile. Rust ha alcuni

tipi di numeri integrati; il u32 visto qui è un intero senza segno a 32-bit.

È una buona scelta predefinita per un piccolo numero positivo. Imparerai a conoscere

altri tipi di numeri nel Capitolo 3.

Inoltre, l'annotazione u32 in questo programma di esempio e la comparazione

con secret_number significano che Rust dedurrà che secret_number dovrebbe essere

anche un u32. Quindi ora la comparazione sarà tra due valori dello stesso tipo!

Il metodo parse funzionerà solo su caratteri che possono logicamente essere convertiti

in numeri e quindi può facilmente causare errori. Se, ad esempio, la stringa

conteneva A👍%, non ci sarebbe modo di convertirlo in un numero. Poiché potrebbe

fallire, il metodo parse restituisce un tipo Result, proprio come il metodo

read_line (discusso in precedenza in “Gestire i fallimenti potenziali con

Result”). Tratteremo

questo Result nello stesso modo usando di nuovo il metodo expect. Se parse

restituisce una variante Err Result perché non è stato in grado di creare un numero dalla

stringa, la chiamata expect farà crashare il gioco e stampare il messaggio che gli diamo.

Se parse può convertire con successo la stringa in un numero, restituirà la

variante Ok di Result, e expect restituirà il numero che vogliamo dal

valore Ok.

Eseguiamo il programma ora:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished dev [unoptimized + debuginfo] target(s) in 0.43s

Running `target/debug/guessing_game`

Indovina il numero!

Il numero segreto è: 58

Per favore inserisci il tuo guess.

76

Hai indovinato: 76

Troppo grande!

Bello! Anche se erano stati aggiunti spazi prima del guess, il programma ha comunque capito che l'utente ha indovinato 76. Esegui il programma alcune volte per verificare il comportamento diverso con diversi tipi di input: indovina il numero correttamente, indovina un numero che è troppo alto, e indovina un numero che è troppo basso.

Abbiamo quasi tutto il gioco funzionante ora, ma l'utente può fare solo un guess. Modifichiamolo aggiungendo un loop!

Permettere Molteplici Guess con Looping

La keyword loop crea un loop infinito. Aggiungeremo un loop per dare agli utenti

più possibilità di indovinare il numero:

Filename: src/main.rs

use rand::Rng;

use std::cmp::Ordering;

use std::io;

fn main() {

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

// --snip--

println!("The secret number is: {secret_number}");

loop {

println!("Please input your guess.");

// --snip--

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

let guess: u32 = guess.trim().parse().expect("Please type a number!");

println!("You guessed: {guess}");

match guess.cmp(&secret_number) {

Ordering::Less => println!("Too small!"),

Ordering::Greater => println!("Too big!"),

Ordering::Equal => println!("You win!"),

}

}

}Come puoi vedere, abbiamo spostato tutto dal prompt di inserimento del guess in poi dentro un loop. Assicurati di indentare le righe all'interno del loop di ulteriori quattro spazi ciascuna e esegui nuovamente il programma. Ora il programma chiederà un altro guess all'infinito, il che introduce un nuovo problema. Non sembra che l'utente possa uscire!

L'utente potrebbe sempre interrompere il programma utilizzando la scorciatoia da tastiera

ctrl-c. Ma c'è un altro modo per sfuggire a questo insaziabile

mostro, come menzionato nella discussione del parse in “Comparare il Guess al

Numero Segreto”: se

l'utente inserisce una risposta non numerica, il programma si bloccherà. Possiamo trarre

vantaggio di ciò per consentire all'utente di uscire, come mostrato qui:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished dev [unoptimized + debuginfo] target(s) in 1.50s

Running `target/debug/guessing_game`

Indovina il numero!

Il numero segreto è: 59

Per favore inserisci il tuo guess.

45

Hai indovinato: 45

Troppo piccolo!

Per favore inserisci il tuo guess.

60

Hai indovinato: 60

Troppo grande!

Per favore inserisci il tuo guess.

59

Hai indovinato: 59

Hai vinto!

Per favore inserisci il tuo guess.

quit

thread 'main' panicked at 'Per favore digita un numero!: ParseIntError { kind: InvalidDigit }', src/main.rs:28:47

note: run with `RUST_BACKTRACE=1` environment variable to display a backtrace

Digitare quit uscirà dal gioco, ma come noterai, anche inserire qualsiasi

altro input non numerico farà lo stesso. Questo è subottimale, per non dire altro; vogliamo che il gioco

si fermi anche quando il numero corretto è stato indovinato.

Uscire Dopo un Indovinamento Corretto

Programmiamo il gioco per uscire quando l'utente vince aggiungendo una dichiarazione break:

Filename: src/main.rs

use rand::Rng;

use std::cmp::Ordering;

use std::io;

fn main() {

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("The secret number is: {secret_number}");

loop {

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

let guess: u32 = guess.trim().parse().expect("Please type a number!");

println!("You guessed: {guess}");

// --snip--

match guess.cmp(&secret_number) {

Ordering::Less => println!("Too small!"),

Ordering::Greater => println!("Too big!"),

Ordering::Equal => {

println!("You win!");

break;

}

}

}

}Aggiungere la riga break dopo Hai vinto! fa uscire il programma dal loop

quando l'utente indovina correttamente il numero segreto. Uscire dal loop significa

anche uscire dal programma, perché il loop è l'ultima parte di main.

Gestire Input Non Validi

Per affinare ulteriormente il comportamento del gioco, invece di far crashare il programma quando

l'utente inserisce un non-numero, facciamo in modo che il gioco ignori un non-numero così l'utente

può continuare a indovinare. Possiamo farlo modificando la riga in cui guess

è convertito da una String a un u32, come mostrato nel Listing 2-5.

use rand::Rng;

use std::cmp::Ordering;

use std::io;

fn main() {

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("The secret number is: {secret_number}");

loop {

println!("Please input your guess.");

let mut guess = String::new();

// --snip--

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

let guess: u32 = match guess.trim().parse() {

Ok(num) => num,

Err(_) => continue,

};

println!("You guessed: {guess}");

// --snip--

match guess.cmp(&secret_number) {

Ordering::Less => println!("Too small!"),

Ordering::Greater => println!("Too big!"),

Ordering::Equal => {

println!("You win!");

break;

}

}

}

}Passiamo da una chiamata expect a un'espressione match per passare dal crash

su un errore alla gestione dell'errore. Ricorda che parse restituisce un tipo

Result e Result è un enum che ha le varianti Ok e Err. Stiamo usando

un'espressione match qui, come abbiamo fatto con il risultato di Ordering del metodo cmp.

Se parse è in grado di convertire con successo la stringa in un numero, restituirà

un valore Ok che contiene il numero risultante. Quel valore Ok corrisponderà

al pattern del primo Ramo, e l'espressione match restituirà semplicemente il valore

num che parse ha prodotto e inserito nel valore Ok. Quel numero

finirà esattamente dove lo vogliamo nella nuova variabile guess che stiamo creando.